Musik-Player der Zukunft kommt von der JKU

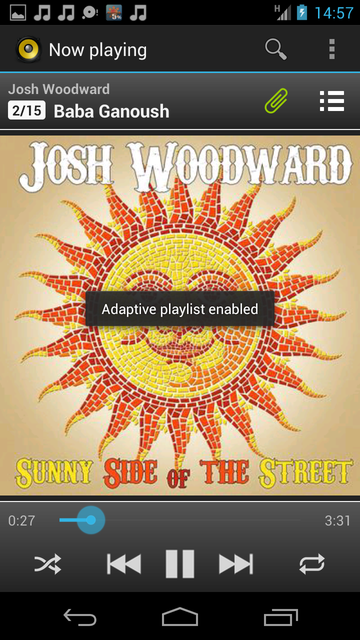

- Der Musik-Player der JKU soll auch auf die Stimmung des Hörers eingehen können.

- Foto: JKU

- hochgeladen von Stefan Paul

Am Institut für Computational Perception der Johannes Kepler Universität (JKU) Linz wird gerade an der Entwicklung eines intelligenten Musikplayers gearbeitet, der sich nicht nur die Hörgewohnheiten, sondern auch den Geschmack des Hörers merkt und sogar versucht, seine Gefühlsstimmungen zu erkennen und entsprechend darauf zu reagieren. Eine wichtige Rolle dabei spielen soziale Netzwerke wie Twitter.

Youtube, Spotify, Deezer, Last.fm sind aus der weltweiten Musikcommunity nicht mehr wegzudenken. Diese Onlineportale bzw. Streaming Services erfreuen sich sogar immer größerer Beliebtheit, weil sie es schaffen, fast maßgeschneidert auf die Wünsche der Nutzer einzugehen und jene Musik zu spielen bzw. zu speichern, die ihnen am ehesten zusagt. Zurzeit können diese Anbieter allerdings nur Songs oder Videos abspielen und Empfehlungen für ähnliche Musikstücke abgeben. Markus Schedl vom Institut für Computational Perception arbeitet gemeinsam mit seinem Team an der Entwicklung eines intelligenten Players, der nicht nur die Lieblingssongs findet, sondern auch die Umgebung des Hörers erkennt und darauf reagiert.

Individueller Player für jeden Geschmack

Für dieses Forschungsprojekt wird unter anderem das sogenannte Social Media Mining herangezogen. Dabei handelt es sich um Datengewinnung bzw. Ableitung von semantischer Information, basierend auf der virtuellen Welt der sozialen Netzwerke, allen voran Microblogs wie Twitter und auch Facebook. „Einer unserer Forschungsschwerpunkte ist es Ähnlichkeitsmaße auf Basis der Informationen aus der Welt von Twitter & co. zu definieren und so soziale Ähnlichkeiten abzuleiten. Bisher arbeiten die herkömmlichen Players stark mit contentbasierter Ähnlichkeit. Diese analysiert das Audiosignal und extrahiert daraus direkt die Eigenschaftsmerkmale, um so die Distanzen zu berechnen und Ähnlichkeiten zwischen Musikstücken widerzuspiegeln. Wir gehen einen Schritt weiter und wollen noch stärker den Kontext miteinbeziehen“, erklärt Schedl. Die Wahrnehmung von Musik manifestiere sich nicht allein durch das Audiosignal, es gebe diverse andere Faktoren die ausschlaggebend sind: Während eine Person zwei Lieder ähnlich findet, bei denen auch die Texte ähnlich sind, sind es bei einer anderen eher die Ähnlichkeiten des Rhythmus oder der Instrumentierung. „Die contentbasierten Ansätze sind an ihre Grenzen gestoßen und zwar aus dem Grund, weil jeder Mensch die Musik individuell empfindet“, so Schedl.

Hashtags als wertvolle Datenquelle

Um herauszufinden, wie das Ähnlichkeitsempfinden bei den Hörern ausgeprägt ist, untersuchen die Forscher Microblogs wie Twitter. Konkret werden die Hashtags (wie z.B. #ladygaga oder #nowplaying @madonna) analysiert, von denen angenommen wird, dass sie Hörgewohnheiten widerspiegeln. Hieraus können Ähnlichkeiten berechnet werden - es kann aber auch vorhergesagt werden, welche Musik gerade in welchen Teilen der Welt populär ist. Die Verknüpfung solcher Information mit dem Benutzerkontext (z.B. Aktivität, Umgebungslautstärke, Wetter oder soziales Umfeld) ermöglicht es, adaptive Wiedergabelisten zu erstellen, die sich der momentanen Situation des Benutzers anpassen. „Es sollen dann die passenden Songs für die jeweiligen Momente gespielt und so ein optimales Hörvergnügen gewährleistet werden.“

Aktuelle Nachrichten aus Linz auf

Aktuelle Nachrichten aus Linz auf  Du willst eigene Beiträge veröffentlichen?

Du willst eigene Beiträge veröffentlichen?

Kommentare

Du möchtest kommentieren?

Du möchtest zur Diskussion beitragen? Melde Dich an, um Kommentare zu verfassen.